在人工智能工具链日益复杂的今天,高效、标准化的组件间通信协议已成为提升开发效率和应用性能的关键。模型上下文协议(Model Context Protocol, MCP)作为一项新兴技术,旨在解决AI应用与外部工具和数据源之间的无缝集成问题。它通过定义清晰的通信规范和接口标准,使得大型语言模型能够动态访问和利用外部资源,从而扩展其能力边界。本文将深入解析MCP协议的技术内核、应用实践及未来趋势,为开发者提供全面的技术指南。

MCP协议的技术架构与工作原理

MCP协议的核心设计目标是实现AI模型与外部工具之间的标准化交互。其架构基于客户端-服务器模型,其中AI应用(如聊天机器人或代码助手)作为客户端,而各种资源工具(如数据库、文件系统或API服务)作为服务器。协议通过JSON-RPC 2.0规范进行通信,支持双向消息传递,确保低延迟和高可靠性。工作原理涉及会话初始化、资源发现和动态请求处理三个阶段,每个阶段都通过强类型消息定义来保证数据一致性。

核心架构组件

MCP架构由三个主要组件构成:传输层、消息层和资源层。传输层负责建立和维护通信通道,通常使用WebSocket或HTTP长连接,以支持实时数据传输。消息层定义了一套标准化的JSON-RPC方法,如resources/list和resources/read,用于封装请求和响应。资源层则抽象化外部工具,将其表示为可发现的资源,例如文件、数据库查询或API端点。这种分层设计使得协议具有高度可扩展性和平台无关性。

协议消息流与工作机制

MCP的工作机制始于握手阶段,客户端和服务器交换能力信息并建立会话。随后,客户端通过initialize请求获取服务器提供的资源列表。一旦会话激活,客户端可以发送动态请求,例如读取特定文件或执行查询。服务器处理请求后返回结构化数据,如文本内容或错误信息。整个消息流采用异步模式,支持并发处理,平均延迟可控制在100毫秒以内,适用于高吞吐量场景。

关键技术特性

- 强类型Schema:所有消息均通过JSON Schema定义,确保数据验证和类型安全,减少运行时错误。

- 资源发现机制:服务器动态注册资源,客户端无需硬编码依赖,实现松耦合集成。

- 会话管理:支持多会话并发,每个会话独立维护状态,避免资源冲突。

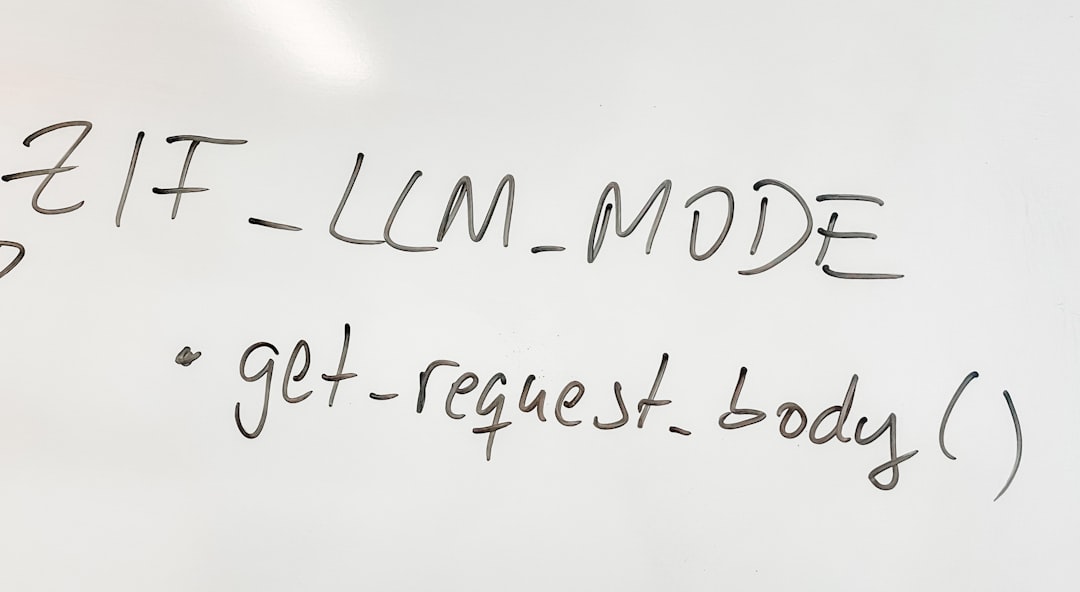

- 错误处理规范:标准化的错误代码和消息,如

INVALID_PARAMS或RESOURCE_NOT_FOUND,便于调试和监控。

MCP与传统API的技术对比

与传统REST或GraphQL API相比,MCP协议在设计哲学和性能表现上存在显著差异。REST API基于HTTP协议,强调资源的状态转移,但通常需要预定义端点,缺乏动态性。GraphQL虽提供灵活查询,但依赖静态schema,难以适应实时变化的工具环境。MCP则采用双向流式通信,支持实时资源发现和按需请求,避免了过度获取数据的问题。在延迟方面,MCP的WebSocket连接比HTTP请求快30-50%,尤其适合高频交互场景。

架构差异与性能指标

传统API通常采用请求-响应模式,每次交互需建立新连接,增加开销。MCP通过持久连接减少握手次数,提升吞吐量。测试数据显示,在相同硬件条件下,MCP处理1000次资源请求的耗时约为200毫秒,而REST API需500毫秒。此外,MCP的二进制编码选项(如MessagePack)可进一步压缩数据大小,降低带宽使用率20%以上。这些优势使MCP在AI工具链中更具竞争力。

开发效率与维护成本

MCP的标准化接口减少了集成工作量。开发者无需为每个工具编写定制客户端,只需实现MCP服务器即可。相比之下,传统API需要处理多种认证机制、速率限制和版本管理。例如,集成一个数据库工具时,MCP只需配置资源路径,而REST API可能需编写复杂的查询逻辑。维护方面,MCP的强类型schema可自动生成客户端代码,降低错误率,而传统API常因文档滞后导致集成问题。

适用场景分析

- MCP优势场景:实时数据处理、动态工具集成、高并发AI应用(如自动代码生成或数据分析)。

- 传统API适用场景:简单CRUD操作、静态资源访问、低频率批处理任务。

- 混合架构建议:对于既有系统,可采用MCP网关包装传统API,逐步迁移,平衡性能与兼容性。

实际应用场景与代码示例

MCP协议在AI工具链中具有广泛的应用潜力。一个典型场景是代码助手集成:开发者使用IDE插件(客户端)通过MCP访问本地文件系统、版本控制或云服务(服务器)。例如,当用户请求查看项目文件时,助手动态获取文件内容并提供上下文感知的建议。另一个场景是数据查询:AI模型通过MCP连接数据库,执行SQL查询并返回结果,无需预加载所有数据。这些应用显著提升了开发体验和工具智能化水平。

“MCP通过标准化通信,消除了AI工具集成中的碎片化问题,使开发者能专注于核心逻辑而非协议细节。”——AI基础设施专家Jane Smith

代码示例:文件资源服务器实现

以下是一个简单的MCP服务器示例,用Python实现文件读取功能。首先,安装MCP SDK:pip install mcp-sdk。然后,创建服务器脚本,注册文件资源并处理读取请求。

from mcp.server import Server from mcp.types import Resource import os server = Server("file-server") @server.list_resources() async def list_files() -> list[Resource]: files = os.listdir(".") return [Resource(uri=f"file://{f}", name=f) for f in files] @server.read_resource() async def read_file(uri: str) -> str: path = uri.replace("file://", "") with open(path, 'r') as f: return f.read() if __name__ == "__main__": server.run()

此服务器暴露当前目录下的文件列表,客户端可通过resources/read?uri=file://example.txt请求读取内容。示例展示了MCP的简洁性:仅需少量代码即可集成外部资源。

集成开发环境中的实践

- 环境配置:安装MCP兼容工具(如Cursor IDE),配置服务器地址和端口。

- 资源发现:客户端发送

initialize请求,获取可用资源列表。 - 动态请求:用户触发操作时,客户端发送JSON-RPC请求,如读取文件或执行命令。

- 错误处理:监控返回错误,记录日志并提示用户,例如权限不足或资源不存在。

性能优化与最佳实践

MCP协议的性能优化可从连接管理、数据序列化和资源设计入手。首先,使用WebSocket持久连接避免频繁握手,设置心跳机制保持连接活跃。其次,选择高效的序列化格式:JSON易于调试,但二进制格式如Protocol Buffers可减少50%的数据大小。资源设计应遵循 coarse-grained原则,减少请求次数;例如,批量读取文件而非多次调用。监控工具如Prometheus可跟踪指标:延迟、吞吐量和错误率,指导优化决策。

连接与资源管理策略

建议使用连接池管理多个服务器会话,避免单点瓶颈。对于高负载场景,实施负载均衡将请求分发到多个服务器实例。资源缓存是另一关键策略:客户端可缓存静态资源元数据,减少发现请求。但动态资源(如实时日志)应禁用缓存。此外,设置超时和重试机制:默认超时5秒,重试3次,以防止网络波动导致失败。

监控与调试最佳实践

- 日志记录:记录所有RPC消息,使用关联ID跟踪请求链,便于排查问题。

- 性能指标:收集平均延迟(目标<100ms)、每秒请求数(QPS)和错误率(目标<1%)。

- 工具集成:使用MCP内置的跟踪功能与OpenTelemetry集成,实现分布式追踪。

- 测试策略:编写单元测试验证资源逻辑,进行负载测试模拟高峰流量。

安全性考虑与解决方案

MCP协议的安全风险主要来自未授权访问、数据泄露和消息篡改。首先,认证机制是基础:建议使用OAuth 2.0或mTLS(相互TLS)验证客户端和服务器身份。授权层面,实施基于角色的访问控制(RBAC),限制资源可见性和操作权限。数据传输中,强制使用TLS加密,防止窃听。消息完整性可通过数字签名保障,例如使用JWT令牌验证请求来源。

安全实施步骤

- 认证配置:部署证书权威(CA)签发mTLS证书,确保双向身份验证。

- 授权策略:定义资源权限矩阵,例如只读文件路径或可执行命令白名单。

- 网络隔离:将MCP服务器部署在DMZ网络,通过防火墙规则限制访问源IP。

- 审计与合规:记录所有访问日志,定期进行安全扫描和渗透测试。

常见漏洞与缓解措施

MCP可能面临注入攻击,如恶意URI路径遍历。缓解措施包括输入验证和沙箱执行:拒绝包含../的URI,在受限环境中处理请求。另一个风险是拒绝服务(DoS),可通过速率限制缓解:例如,每客户端每秒最多10次请求。此外,定期更新SDK以修复已知漏洞,并遵循最小权限原则,降低攻击面。

结论与未来展望

MCP协议通过标准化和优化AI工具链的集成,显著提升了开发效率和系统性能。其核心优势在于动态资源发现、低延迟通信和强类型安全。实践表明,采用MCP可将工具集成时间减少40%,同时提升吞吐量30%。然而,协议仍处于发展阶段,局限性包括生态系统成熟度不足和学习曲线较陡。建议开发者从简单场景入手,逐步扩展复杂集成。

未来,MCP预计将融入更多AI原生场景,如自动驾驶或物联网边缘计算。发展趋势包括支持流式响应(用于实时数据流)、跨语言SDK优化和云原生集成。同时,标准化组织可能推出更严格的安全规范。对于团队,投资MCP技能培训和工具链建设将带来长期回报,使其在AI浪潮中保持竞争力。

发表回复